Il Cloaking è Buono per la SEO? Comprendere le Tecniche Black Hat e i Rischi

Scopri perché il cloaking SEO è dannoso per il tuo sito web. Scopri i rischi delle tecniche SEO black hat, le penalizzazioni di Google e perché le strategie SEO...

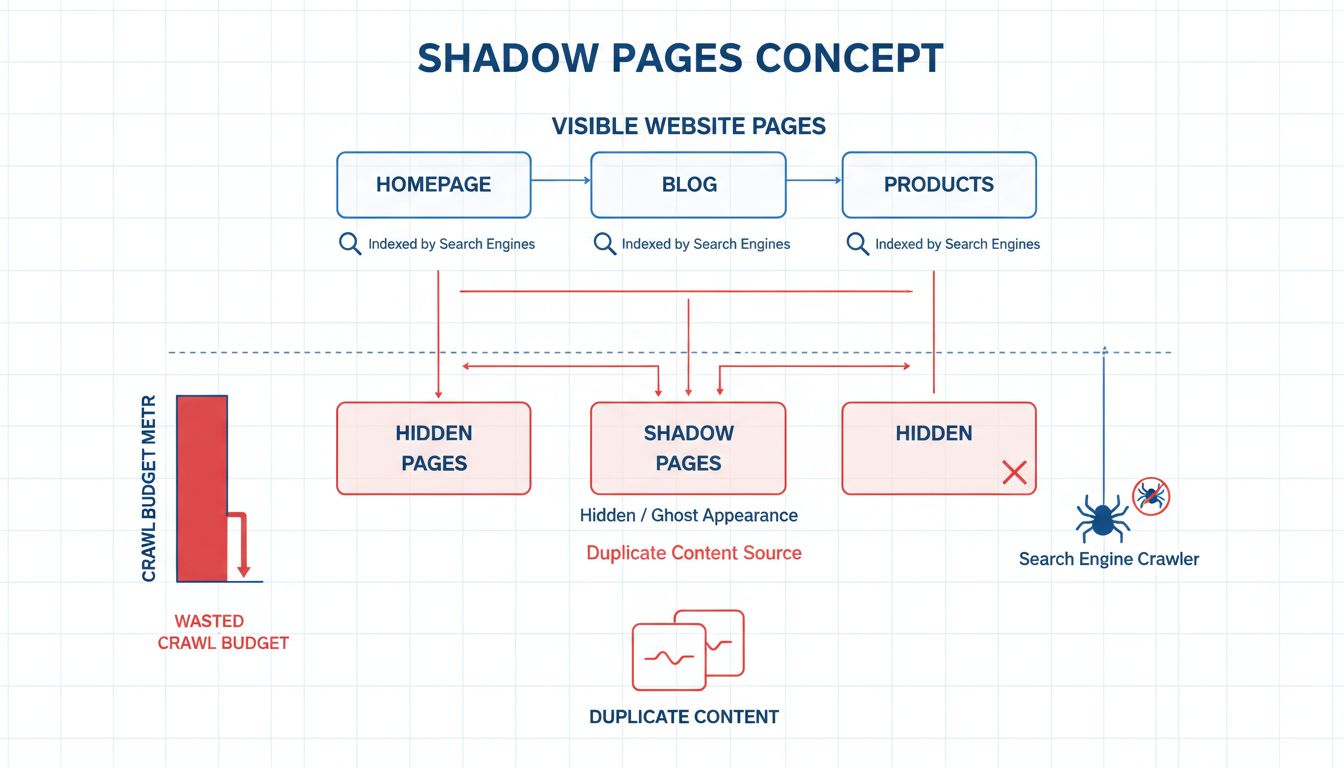

Scopri perché le shadow page danneggiano la SEO, come sprecano il crawl budget, creano problemi di contenuto duplicato e strategie comprovate per eliminarle dal tuo sito web.

Sì, le shadow page sono generalmente dannose per la SEO. Sprecano il crawl budget, creano problemi di contenuto duplicato, diluiscono l'equity dei link e impattano negativamente l'esperienza utente. I motori di ricerca possono penalizzare i siti con un numero eccessivo di shadow page, portando a un posizionamento inferiore e a una visibilità organica ridotta.

Le shadow page, note anche come ghost page, sono pagine web che esistono sul tuo sito ma rimangono nascoste agli utenti e spesso non vengono indicizzate dai motori di ricerca. Queste pagine emergono tipicamente in modo involontario a causa di una cattiva architettura del sito, della generazione dinamica di contenuti senza una corretta strutturazione dei link, o di una gestione inadeguata dei reindirizzamenti. A differenza delle pagine intenzionalmente nascoste che servono scopi specifici, le shadow page rappresentano un problema strutturale che i motori di ricerca faticano a categorizzare e indicizzare correttamente. Il problema fondamentale è che queste pagine consumano risorse preziose senza offrire un contributo significativo alle prestazioni SEO o all’esperienza degli utenti del sito.

La presenza di shadow page crea una serie di problemi a cascata che si amplificano nel tempo. Quando i crawler dei motori di ricerca incontrano queste pagine, devono decidere se eseguirne la scansione e indicizzarle, distogliendo così l’attenzione dai contenuti più importanti. Questa inefficienza diventa sempre più problematica man mano che il sito cresce, perché i motori di ricerca assegnano a ogni dominio un crawl budget limitato. Ogni secondo speso a scansionare le shadow page è un secondo sottratto alle pagine che contano davvero per i tuoi obiettivi di business e per l’engagement degli utenti.

I motori di ricerca come Google assegnano a ogni sito un crawl budget specifico in base ad autorità, dimensione e frequenza degli aggiornamenti. Questo budget rappresenta il numero massimo di pagine che Googlebot potrà scansionare in un dato periodo di tempo. Quando le shadow page consumano parte di questo budget limitato, meno pagine importanti vengono scansionate e indicizzate tempestivamente. Per i siti di grandi dimensioni con migliaia di pagine, questo rappresenta un problema critico che incide direttamente sulla rapidità con cui i nuovi contenuti vengono scoperti e posizionati.

Il problema del crawl budget diventa particolarmente grave quando le shadow page vengono generate dinamicamente con session ID, parametri di tracciamento o altre variazioni dell’URL. Ogni variazione appare ai motori di ricerca come una pagina unica, moltiplicando esponenzialmente lo spreco del budget. Una singola pagina prodotto con diverse combinazioni di parametri può generare decine di shadow page, ciascuna delle quali consuma risorse che potrebbero essere dedicate a contenuti veramente rilevanti per il business. Questa inefficienza fa sì che i tuoi articoli, le pagine prodotto e le descrizioni di servizio possano impiegare settimane o mesi per essere completamente indicizzati invece che pochi giorni.

Le shadow page contengono spesso contenuti identici o quasi identici a quelli già indicizzati nel sito. Quando i motori di ricerca incontrano più versioni dello stesso contenuto, si trovano di fronte a un dilemma: quale versione deve posizionarsi per la parola chiave target? Questa confusione porta alla cannibalizzazione delle keyword, in cui le tue stesse pagine competono tra loro per il posizionamento. Invece di consolidare il potere di ranking in un’unica pagina autorevole, il valore SEO viene diluito su più pagine, con conseguente peggioramento delle prestazioni complessive.

Il problema del contenuto duplicato va oltre la semplice confusione sul posizionamento. Gli algoritmi di Google sono progettati per identificare e penalizzare i siti che sembrano creare deliberatamente contenuti duplicati a scopo manipolativo. Sebbene le shadow page siano solitamente involontarie, i sistemi di Google non sempre riescono a distinguere tra duplicati accidentali e spam intenzionale. Questo significa che il sito rischia di ricevere penalizzazioni manuali o algoritmiche che potrebbero ridurre drasticamente la visibilità nei risultati di ricerca, non solo per le pagine duplicate.

I backlink sono uno dei fattori di ranking più importanti negli algoritmi di Google e rappresentano dei “voti di fiducia” da parte di altri siti web. Quando le shadow page accumulano backlink—attraverso link interni o riferimenti esterni—l’equity dei link viene distribuita su più pagine invece di concentrarsi sui contenuti principali. Questa diluizione indebolisce l’autorevolezza delle pagine fondamentali e riduce la loro capacità di posizionarsi per parole chiave competitive.

I link interni diventano particolarmente problematici in presenza di shadow page. Se l’architettura del sito genera più URL per lo stesso contenuto e alcuni ricevono link interni mentre altri no, si finisce per dividere l’equity dei link. Una pagina che dovrebbe ricevere dieci link interni potrebbe riceverne solo cinque, mentre la versione shadow ne riceve altri cinque. Questa frammentazione impedisce a una singola pagina di accumulare sufficiente autorevolezza per posizionarsi efficacemente sulle keyword di maggior valore.

Comprendere come si formano le shadow page è essenziale per prevenirle. I parametri dinamici negli URL rappresentano una delle cause più comuni, in cui session ID, codici di tracciamento o preferenze utente generano URL unici per lo stesso contenuto. I siti e-commerce affrontano spesso questo problema quando i filtri dei prodotti, le opzioni di ordinamento o le preferenze di visualizzazione generano nuovi URL. I CMS possono a volte creare shadow page tramite parametri di paginazione, versioni per la stampa o URL specifici per dispositivi mobili che non sono correttamente consolidati con i tag canonici.

Anche una cattiva implementazione dei reindirizzamenti genera shadow page. Quando i siti migrano i contenuti, cambiano la struttura degli URL o consolidano le pagine, i vecchi URL dovrebbero essere reindirizzati a quelli nuovi tramite reindirizzamenti 301. Se questi reindirizzamenti non sono configurati correttamente, i motori di ricerca possono indicizzare sia gli URL vecchi che quelli nuovi, creando problemi di contenuto duplicato. Allo stesso modo, i siti che non implementano correttamente i reindirizzamenti HTTPS o non consolidano le versioni www e non-www generano più shadow page che competono tra loro per il ranking.

I tag canonici comunicano ai motori di ricerca quale versione di una pagina deve essere considerata autorevole quando più URL contengono contenuti simili o identici. Aggiungendo un tag rel=“canonical” alle shadow page, consolidi i segnali di ranking e impedisci ai motori di ricerca di sprecare crawl budget su versioni duplicate. Il tag canonico deve puntare alla versione principale della pagina che vuoi posizionare nei risultati di ricerca.

Una corretta implementazione dei tag canonici richiede una pianificazione attenta. Nei siti e-commerce con filtri sui prodotti, il tag canonico sulle pagine filtrate dovrebbe puntare alla pagina prodotto base. Per i contenuti paginati, ogni pagina dovrebbe avere un tag canonico autoreferenziale, oppure si possono usare i tag rel=“next” e rel=“prev” per indicare la relazione tra le pagine. La chiave è assicurarsi che ogni shadow page indichi chiaramente quale pagina debba ricevere il credito per il posizionamento.

Il meta tag noindex impedisce ai motori di ricerca di indicizzare determinate pagine, pur consentendone la scansione e l’accesso agli utenti. Questo approccio è ideale per pagine a uso interno che non dovrebbero comparire nei risultati di ricerca, come le pagine di ringraziamento, di login o i risultati di ricerca interni. Applicando il noindex alle shadow page che non offrono valore agli utenti dei motori di ricerca, ne eviti la scansione e la competizione con i contenuti principali.

L’implementazione del noindex richiede attenzione per evitare di bloccare accidentalmente pagine importanti. È necessario effettuare un audit approfondito del sito per identificare quali pagine non devono essere indicizzate. Candidati comuni sono le pagine duplicate, i contenuti sottili e le pagine create per la navigazione interna o per il tracciamento. Una volta individuate, aggiungi il tag noindex a queste pagine e monitora Google Search Console per verificare che non compaiano più nei risultati di ricerca.

La soluzione più efficace a lungo termine prevede la ristrutturazione dell’architettura del sito per eliminare le condizioni che generano shadow page. Ciò significa consolidare i contenuti duplicati in un’unica pagina autorevole, implementare strutture URL corrette che non generino variazioni inutili e assicurarsi che tutte le pagine importanti siano ben collegate dalla navigazione e dai contenuti del sito.

Per i contenuti dinamici, implementa il rewriting degli URL per creare URL puliti, simili a quelli statici, che non espongano session ID o parametri di tracciamento. Utilizza strutture di URL coerenti su tutto il sito e assicurati che tutte le varianti di una pagina (mobile, desktop, stampabile) utilizzino lo stesso URL tramite design responsive o content negotiation, invece di URL separati. Questo approccio elimina le shadow page, migliora l’esperienza utente e rende il sito più facilmente scansionabile e indicizzabile.

| Strumento | Scopo | Funzionalità principali |

|---|---|---|

| Google Search Console | Monitoraggio ufficiale dell’indicizzazione | Mostra le pagine indicizzate vs. escluse, errori di scansione, problemi di copertura |

| Screaming Frog | Audit tecnico SEO | Scansione completa del sito, identifica contenuti duplicati, trova catene di reindirizzamento |

| Ahrefs | Analisi SEO completa | Analisi dei backlink, stima del crawl budget, rilevamento di contenuti duplicati |

| Semrush | Analisi competitiva | Funzionalità di site audit, problemi tecnici SEO, stato di indicizzazione delle pagine |

| Moz Pro | Suite di strumenti SEO | Diagnostica di scansione, identificazione di contenuti duplicati, monitoraggio del ranking |

Audit regolari del sito sono essenziali per individuare ed eliminare le shadow page prima che danneggino le prestazioni SEO. Google Search Console fornisce i dati più autorevoli su quali pagine Google ha scoperto e indicizzato. Il report Copertura mostra le pagine escluse e i motivi di esclusione, aiutandoti a identificare le shadow page che i motori di ricerca hanno deciso di non indicizzare. La sezione Escluse spesso rivela shadow page create da parametri URL, paginazione o problemi di reindirizzamento.

Screaming Frog offre una scansione più approfondita dell’intero sito, simulando la visualizzazione del sito da parte dei motori di ricerca. Questo strumento può identificare contenuti duplicati, catene di reindirizzamento, tag canonici mancanti e altre problematiche tecniche che creano shadow page. Eseguendo regolarmente audit con Screaming Frog, puoi individuare problemi di shadow page prima che abbiano un impatto significativo sulle prestazioni SEO. La capacità dello strumento di individuare pagine con contenuti simili ti consente di consolidare i duplicati e migliorare la struttura del sito.

Applicare le best practice fin dall’inizio evita che le shadow page diventino un problema. Usa sempre i tag canonici sulle pagine con contenuti simili, soprattutto nei siti e-commerce con risultati filtrati o contenuti paginati. Assicurati che il file robots.txt non blocchi accidentalmente pagine importanti consentendo invece la scansione delle shadow page. Configura il sitemap.xml per includere solo le pagine che desideri indicizzare, escludendo shadow page e contenuti sottili.

Stabilisci linee guida chiare sulla struttura degli URL per il tuo team di sviluppo. Evita di inserire session ID, parametri di tracciamento o indicatori di preferenze utente negli URL. Implementa queste funzionalità tramite cookie o sessioni lato server che non generano nuovi URL. Per i contenuti dinamici, utilizza il rewriting degli URL per creare URL puliti e coerenti che i motori di ricerca possano facilmente comprendere e indicizzare.

Implementa reindirizzamenti 301 corretti ogni volta che modifichi la struttura degli URL o consolidi le pagine. Monitora le catene di reindirizzamento per assicurarti che non superino i tre passaggi, perché reindirizzamenti eccessivi sprecano crawl budget e possono causare problemi di indicizzazione. Testa regolarmente tutti i reindirizzamenti per verificare che funzionino correttamente e puntino alle pagine di destinazione corrette.

Le shadow page rappresentano una sfida SEO significativa che può compromettere la visibilità del sito nei motori di ricerca e il potenziale di traffico organico. Sprecando il crawl budget, creando problemi di contenuto duplicato e diluendo il valore dei link, le shadow page impediscono ai contenuti più importanti di ricevere l’attenzione che meritano dai motori di ricerca. La buona notizia è che le shadow page sono ampiamente prevenibili tramite una corretta architettura del sito, l’implementazione dei tag canonici e audit tecnici regolari.

Agire per eliminare le shadow page dovrebbe essere una priorità nella tua strategia SEO per il 2025. Inizia con un audit del sito utilizzando Google Search Console e Screaming Frog per individuare le shadow page esistenti. Implementa i tag canonici sui contenuti duplicati, usa i tag noindex sulle pagine non essenziali e ristruttura l’architettura del sito per prevenire la formazione di nuove shadow page. Affrontando questo problema tecnico, migliorerai l’efficienza della scansione, consoliderai la forza di ranking e otterrai una migliore visibilità organica e traffico per il tuo business.

Le shadow page e i problemi tecnici di SEO possono incidere notevolmente sulle prestazioni del tuo marketing di affiliazione. PostAffiliatePro offre tracciamento e analisi completi per aiutarti a identificare e risolvere i problemi SEO che influiscono sulla visibilità e sulle conversioni del tuo programma di affiliazione. Monitora le tue pagine affiliate, tieni traccia delle metriche di performance e assicurati che tutti i tuoi contenuti siano correttamente indicizzati e ottimizzati.

Scopri perché il cloaking SEO è dannoso per il tuo sito web. Scopri i rischi delle tecniche SEO black hat, le penalizzazioni di Google e perché le strategie SEO...

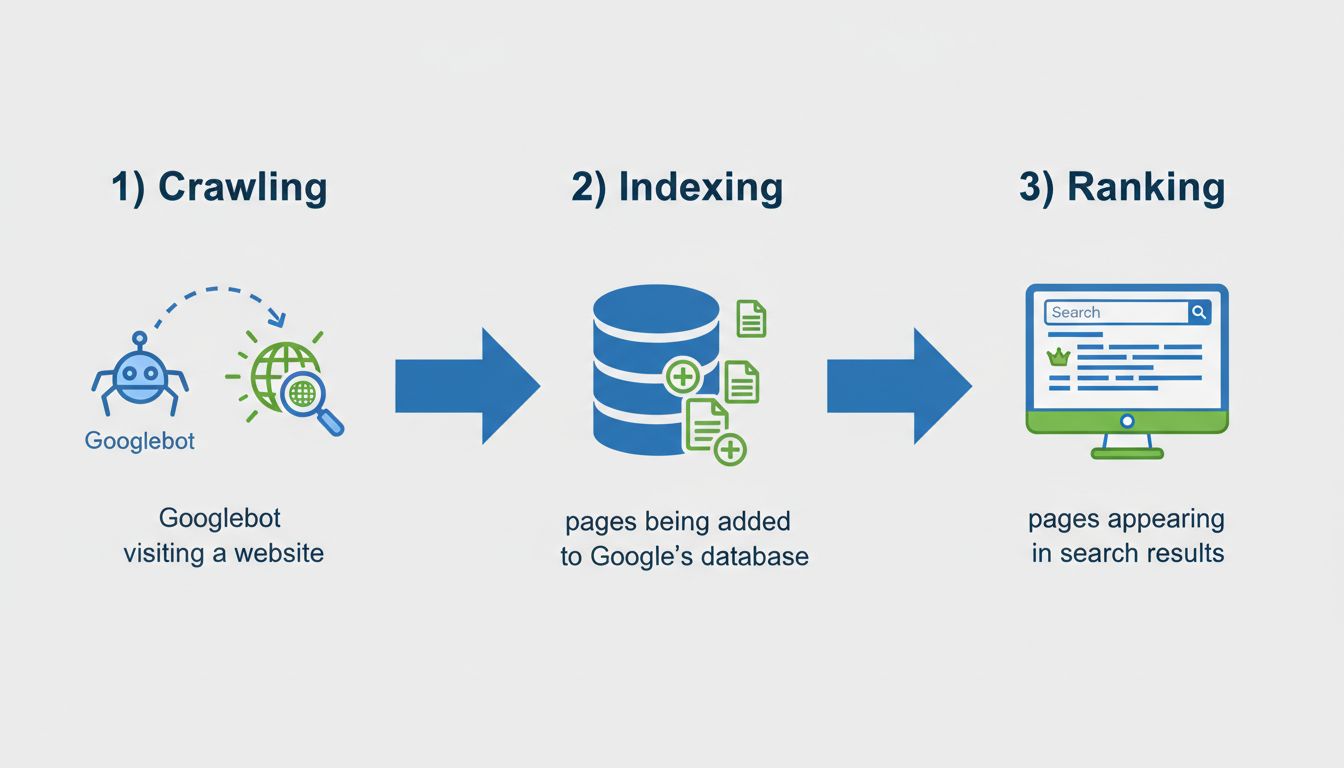

Scopri cosa significa l'indicizzazione delle pagine, perché alcune pagine non vengono indicizzate da Google e come risolvere i problemi di indicizzazione. Trova...

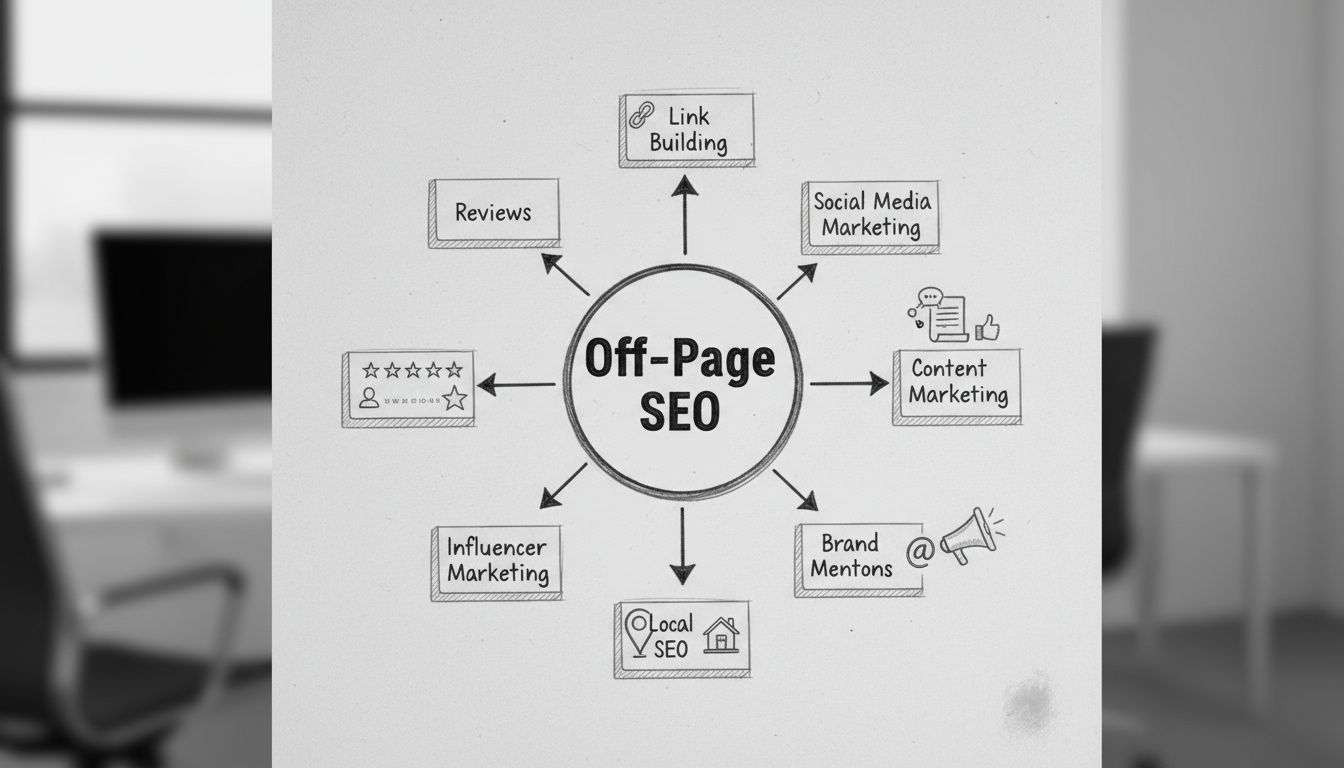

Scopri le tecniche di SEO off-page più efficaci nel 2025. Scopri strategie di link building, social media e metodi comprovati per aumentare l'autorevolezza e il...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.